日本理化学研究所生命功能科学研究中心生物计算研究团队的田中信行高级研究员,理化学研究所环境资源科学研究中心质谱与显微镜分析单元的藤田美纪高级技师等,与大阪大学研究生院基础工学研究科的张竣博(研究生,兼任该团队研修生)和万伟伟副教授(兼任该团队客座研究员)等人组成的研究团队宣布,成功开发出了一种能够识别非规范化实验环境并自动生成机械臂动作,自主进行实验的AI系统。

这种可以自主生成适当实验操作的生成式AI,是通过将通用的协作机械臂与计算机上构建的三维模型结合开发而成。实验证明,它可以针对每个个体识别植物的形状,并自动化执行向特定条件的叶片添加溶液,该实验设备已于2023年12月25日公开。这一成果有望推动以时刻变化的植物、细胞、化合物等为研究对象的自动化实验。相关研究成果已发表在国际学术期刊《IEEE TRANSACTIONS ON AUTOMATION SCIENCE AND ENGINEERING》杂志的2023年11月27日刊上。

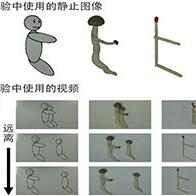

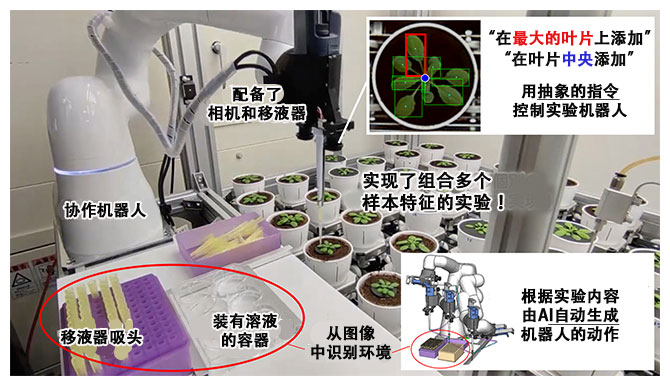

图 能够观察和思考的自动实验机器人,可为植物进行液体精密添加(供图:理化学研究所)

在当前生命现象和物质科学等领域的研究中,需要进行大量的实验和观察,以便获取数据,并排除实验者对研究对象的影响,因此,通过机器人实现实验自动化的研究备受期待。然而,要实现这种自动化,必须具备与机器人相匹配的实验环境和程序等,此外,还需要针对时刻变化的对象,例如对植物和细胞的大小和形状进行判断并添加试剂,这样外部参数设定此前尚未实现。

研究团队为了解决上述问题,尝试为基于机器人和AI的系统赋予能够灵活应对各种实验条件的自主性,从而实现自主实验。

作为自主实验的模型,研究团队开发了一个能够进行用移液器测量微量液体并滴加到样本中的AI操作系统。包括移液器吸头的安装、滴加后的拆卸以及反复执行操作的一系列步骤都被考虑在该系统内。

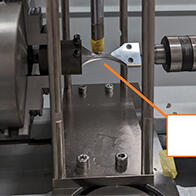

首先,研究人员对人工实验的操作进行了分析,明确了机器人执行动作所需的构成要素。为了将操作的主体替换为机器人,他们在与人类共同工作的机器人(协作机器人)的机械臂末端,安装了两台相机和微型移液器,用于观察实验环境。移液器采用了实验室常用的类型,为了适应机械臂的操作,研究人员使用3D打印机制作了周围的零件。

由于该协作机器人具备可通过人移动机器人来教授动作的“直接教学”功能,研究人员将其设定为能够通过使用者示范的动作和利用摄像机对周围实验环境进行拍摄,通过AI识别图像数据来识别实验环境。

此外,研究人员通过将机械臂、微型移液管和液体容器等各种实验器具的3D数据读入计算机并构建3D模型的方式,再现了实验环境。进而建立了一个让机器人利用AI学习位置偏差,通过摄像头识别位置偏差后自动计算并随时进行校正的系统。AI方面,研究团队采用了万副教授等人原创开发的WRS系统。

即使实验中使用的器具和样品等的位置不固定,机器人也能自动识别,并随时对位置偏差进行修正。由此,研究人员开发出了可用类似于日常对话的指令,例如“将100微升(μl)溶液1的溶液滴加到样品A上”的语言,即可进行复杂实验的AI机器人系统。

研究人员还将理化学研究所的原创技术——植物自动培养观察系统RIPPS(RIKEN Integrated Plant Phenotyping System)整合到了AI系统中。这一系统能够控制超过100个的植物样本的生长条件,实现一个月以上的自动培养。

这样做的结果是,即便大多数样本在各自的生长过程中发生了形状、叶片大小等方面的变化,但通过该系统仍然能够按照“将20微升(μl)溶液1的溶液滴加到样品A最大的叶片上”的指令工作。

研究人员实际对96个拟南芥样本进行了①选择准备的3种试剂中的1种,②在最大的叶片或者植物体中心滴加等6种类型的自动化实验,验证了AI系统的性能。结果发现,尽管有4例识别错误,但滴加操作本身的成功率达到100%。该系统还可以记录实际滴加位置和时间等数据。

机器人能够在黑暗的房间内工作,而在人工进行的植物实验中,人体呼气的影响是无法忽视的。从这个角度来看,自动化培养的优势明显。

有望加速生命科学领域的研究进展

田中高级研究员表示:“我们认为,此次的研究成果具有识别非规范化实验环境并自动生成机器人的动作的功能,能为人与机器人共同作业的实验提供了基础技术。该技术可应用于诸如植物学中叶片特征解析的研究,以及化学物质合成中的有变化即采样的定期采样等实验。希望该研究能为加速生命科学领域的研究做出贡献。”

原文:《科学新闻》

翻译:JST客观日本编辑部

【论文信息】

杂志:IEEE TRANSACTIONS ON AUTOMATION SCIENCE AND ENGINEERING

论文:Integrating a Pipette Into a Robot Manipulator With Uncalibrated Vision and TCP for Liquid Handling

DOI:10.1109/TASE.2023.3312657